創造的な業務に利用 一方犯罪の道具にも

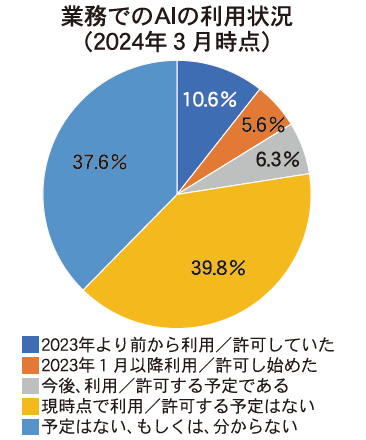

人工知能(AI)に関する話題を耳にすることが、日を追うごとに増している。AIは創造的な業務にも利用できる可能性が高く、人手不足対策や利益率向上などに有効な手段になると期待されている。特に、生成AI(質問や作業指示などに応じて文章や画像などを生成するAIサービス)に関しては、新たな経済成長の起爆剤となり得るという意見もあり、大きな期待が寄せられている。

一方、生成AIを悪用した犯罪も発生している。2023年4月には、ディープフェイク(AIを用いて人物の動画や音声を人工的に合成する処理技術)を用いて誘拐された本人のように聞こえる音声を作成し、電話で被害者に聞かせ、身代金をだまし取ろうとする「バーチャル誘拐」が発生した。また、サイバー犯罪用の生成AIツールも登場し、スピアフィッシングやビジネスメール詐欺などの実行を支援する「WormGPT」、「FraudGPT」がハッキングフォーラムで宣伝されている。加えて、生成AIを悪用したとされる偽情報の拡散も発生している。

国内においては、23年11月に報道番組に似せてつくられた岸田首相のディープフェイク動画がSNS上で拡散され、大きなニュースとなった。海外においては、23年5月に米国の国防総省付近で爆発が起きたとされるフェイク画像がSNSで拡散された。

リスクを秘めたAI 正しい情報の入手を

生成AI利用における注意点を簡単に紹介する。

■AIは間違える

チャットボットなどの生成AIに質問を投げかけると、簡潔でもっともらしい回答を得ることができる。しかし、その回答には誤りが含まれていることがある。回答が本当に正しいのかどうか、自身で確認することが大切である。また、プログラムのソースコード(プログラミング言語で記述されたテキスト)をアウトプットする生成AIサービスを利用する場合には、アウトプットされたコードが脆弱(ぜいじゃく)でないかどうかなどを確認することも大切である。

■AIはおしゃべり

生成AIを利用する際、機密情報をインプットすることで、その生成AIが機密情報を学習に利用し、第三者に機密情報が漏えいする可能性がある。生成AIにインプットする機密情報や個人情報が生成AIでどのように取り扱われるのか規約や仕様を確認することが大切である。また、所属組織において機密情報や個人情報の取り扱いについて規則が決められている場合は、その規則に従うことも重要である。

■AIはだまされる

生成AIは、悪意を持った利用者により、サービス提供者の意図せぬ回答をアウトプットすることがある。また、学習データに利用するインプットに誤りが含まれていると、誤った学習をしてしまい、誤ったアウトプットを行う。これらを防止するために、生成AIを活用したサービスを提供する場合、サービスの公開前にアウトプットの正当性検証を実施するとともに、プロンプトインジェクション(AIに対して特殊な質問をインプットし、AI開発者が想定していない機密情報などの情報を窃取する攻撃)やデータポイズニング(悪意のあるデータをAIに学習させ、AI開発者が想定していない動作をさせる攻撃)などへの対策も実施する。 経済発展や社会問題の解決に寄与する可能性がある一方でリスクも秘めている生成AI。うまく付き合っていくためにも、正しい最新情報を入手していくことが求められる。

「AI利用時のセキュリティ脅威・リスク調査報告書」についてはこちら

(独立行政法人情報処理推進機構・江島将和)